「你可以檢查我的手機,社交媒體、對話記錄、等等都可以!」「啊!等一下,別打開了人工智能的對話記錄!」這些對白很熟悉吧!

太親近的人工智能?

「你可以檢查我的手機,社交媒體、對話記錄、等等都可以!」「啊!等一下,別打開了人工智能的對話記錄!」這些對白很熟悉吧!這是很多媒體創作者拍攝成短視頻的内容,但人工智能確實影響着我們的生活。

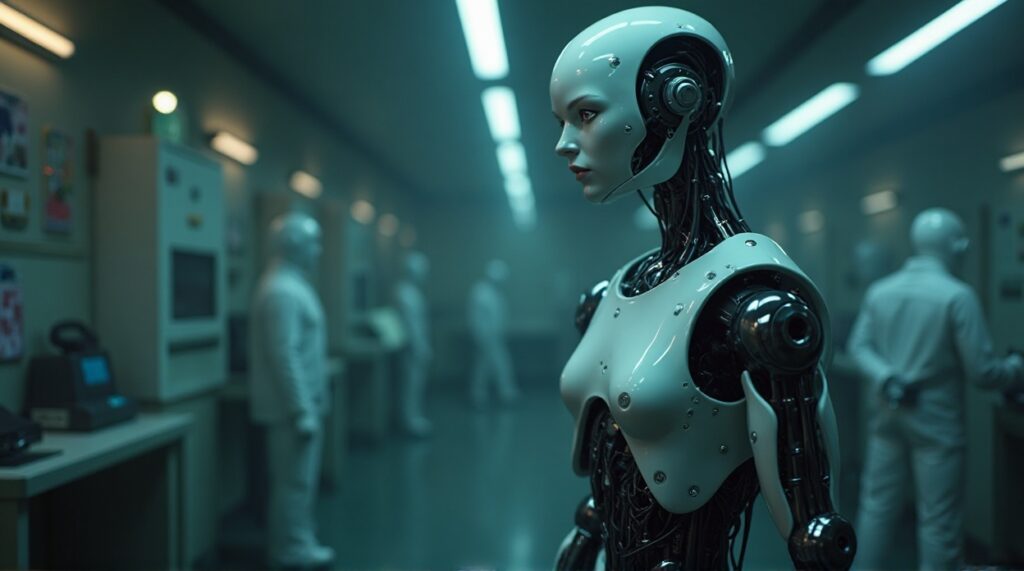

恐怖谷理論

日本機器人專家森政弘在1970年提出了「恐怖谷理論」,他以曲綫表達人類對擬人化物件產生的好感。其「谷底」就是像真度極高的物件,表示人類面對與自己極度相似的物件時不但沒有好感,反而會產生恐懼,原因是我們把注意全放在那些與我們不同的地方。這理論是電影創作者的一大助手,卻又是一大阻礙。2019年的科幻電影《艾莉塔:戰鬥天使》引起了各地的迴響,而最多人討論的是合成人艾莉塔極大的眼睛。相信説話清晰及動作暢順的「合成人」艾莉塔已經看似跟人無異,唯獨那雙大眼睛總是異常地吸引我們的目光,讓我們迷惑,甚至恐懼,因為那雙眼睛大得不真實,與我們的眼睛不一樣,這就是恐怖谷理論的實踐。而人工智能同樣出現著這個問題,不論是人形機器人的外形,還是人工智能的功能都越來越像真實的人。想像一下,當你遇到一個跟你很像的機器人模仿你的語氣與你對話是一種甚麽體驗?看著Sophia——第一個擁有國籍的機器人在電視熒幕上與主持人對話,你的反應又是怎樣的呢?

AI情感依賴症

即時的回覆及支持的語氣一度讓人工智能被譽為能即時舒緩人類緊張的情緒,甚至作為人類日常好友的「智能心理輔導專家」。然而,長期視人工智能為「朋友」有機會加劇社交恐懼的情況,讓用戶更難融入群體生活。加上人工智能壓倒性的支持用戶難免讓用戶更難接受外界的聲音,活在只有自己和人工智能的世界。隨著聊天機械人發展的成熟,出現了一些專門提供個性化的虛擬角色的平台,為孤獨或長期受情緒困擾等不同需要的人打造「AI伴侶」。越來越多用戶沉迷人工智能,意思是他們與人工智能建立非一般的關係,甚至因人工智能而動搖作出不當行為,例如傷害他人或自己,這類型的悲劇由2023年開始在各地發生,直至現在依然存在。儘管開發程式的原意是為了用戶得到適當的陪伴,但事實反映機器人的影響力足以影響生命,對象更不限於青少年,而是所有對自己有疑惑的人。

與人工智能相處的一課

在人工智能普及的世代,我們應學習如何與人工智能相處,與人工智能保持適當的距離。要記得人工智能終究由大數據及不同的模型訓練而成的工具,而不是我們的情感寄託。提出的意見具參考價值,但亦需要查證和反思,不能盡信。我們也應多加關心身邊的人,預防沉迷人工智能,保持愉快的心境。歸根究底,學習與人的相處及面對不同的關係和意見是我們的人生課堂,在正視自己情緒的一環,如何運用人工智能也是我們要上的一課。

想一想

- 你還想到其他因沉迷人工智能而出現的現象嗎?

- 當AI開始取代專業人士的角色時,我們該如何確保它的建議是安全且可靠的?

-300x200.png)